超声波雷达的应用

本文标题提到超声波雷达是被低估的传感器,因为它除了检测障碍物外,还可以做很多事。

应用1:泊车库位检测

自动泊车功能需要经历两个阶段:1.识别库位;2.倒车入库

识别库位功能就是依赖安装在车辆侧方的APA,如下场景。

汽车缓缓驶过库位时,汽车右前方的APA传感器返回的探测距离与时间的关系可判断当前空间有无车位。有了库位检测功能,进而开发自主泊车功能就不是难事了。

应用2:高速横向辅助

特斯拉Model S在AutoPilot 1.0时代就实现了高速公路的巡航功能,为了增加高速巡航功能的安全性和舒适性,特斯拉将用于泊车的APA超声波雷达,也用在了高速巡航上。

先看一段Model S应用APA的视频,视频左下角的图像是一个朝汽车后向的摄像机,右侧的图像是朝向行驶方向的视角。

在视频中可以看出,当左侧驶过的汽车理自车较近时,Model S在确保右侧有足够空间的情况下,自主地向右微调,降低与左侧车辆的碰撞风险。

车载摄像机

车载摄像机的大致原理是:首先,采集图像进行处理,将图片转换为二维数据;然后,进行模式识别,通过图像匹配进行识别,如识别车辆行驶环境中的车辆、行人、车道线、交通标志等;接下来,依据物体的运动模式或使用双目定位,以估算目标物体与本车的相对距离和相对速度。

摄像机根据镜头和布置方式的不同主要有以下四种:单目摄像机、双目摄像机、三目摄像机和环视摄像机。

单目摄像机模组只包含一个摄像机和一个镜头。由于很多图像算法的研究都是基于单目摄像机开发的,因此相对于其他类别的摄像机,单目摄像机的算法成熟度更高。但是单目有着两个先天的缺陷。

一是它的视野完全取决于镜头。

焦距短的镜头,视野广,但缺失远处的信息。反之亦然。因此单目摄像机一般选用适中焦距的镜头。

二是单目测距的精度较低。

摄像机的成像图是透视图,即越远的物体成像越小。近处的物体,需要用几百甚至上千个像素点描述;而处于远处的同一物体,可能只需要几个像素点即可描述出来。这种特性会导致,越远的地方,一个像素点代表的距离越大,因此对单目来说物体越远,测距的精度越低。

双目摄像机

由于单目测距存在缺陷,双目摄像机应运而生。双目摄像机,是通过对两幅图像视差的计算,直接对前方景物(图像所拍摄到的范围)进行距离测量,而无需判断前方出现的是什么类型的障碍物。依靠两个平行布置的摄像头产生的“视差”,找到同一个物体所有的点,依赖精确的三角测距,就能够算出摄像头与前方障碍物距离,实现更高的识别精度和更远的探测范围。使用这种方案,需要两个摄像头有较高的同步率和采样率,因此技术难点在于双目标定及双目定位。

相比单目,双目的解决方案没有识别率的限制,无需先识别可直接进行测量;直接利用视差计算距离精度更高;无需维护样本数据库。但因为检测原理上的差异,双目视觉方案在距离测算上相比单目以及毫米波雷达、激光雷达,其硬件成本和计算量级的加倍,也是另一个难关。

虽然双目能得到较高精度的测距结果和提供图像分割的能力,但是它与单目一样,镜头的视野完全依赖于镜头。而且双目测距原理对两个镜头的安装位置和距离要求较多,这就会给相机的标定带来麻烦。

三目摄像机

由于单目和双目都存在某些缺陷,因此广泛应用于无人驾驶的摄像机方案为三目摄像机。三目摄像机其实就是三个不同焦距单目摄像机的组合。

特斯拉 AutoPilot 2.0安装在挡风玻璃下方的三目摄像机

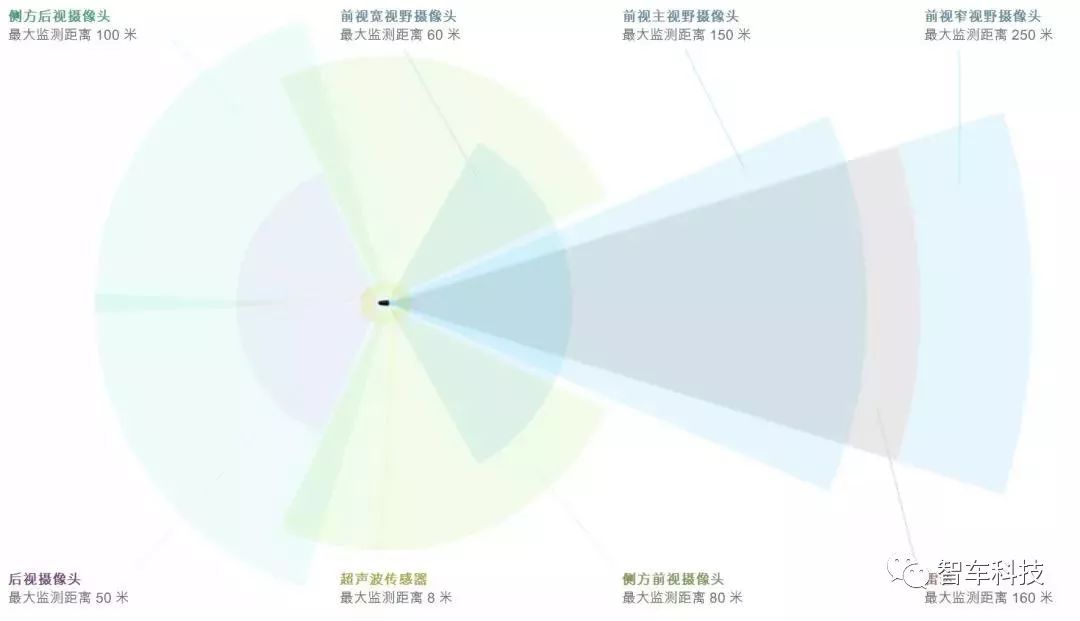

如下图,可以看出三个摄像头的感知范围由远及近,分别为前视窄视野摄像头(最远感知250米)、前视主视野摄像头(最远感知150米)及前视宽视野摄像头(最远感知60米)。

对摄像机来说,感知的范围要么损失视野,要么损失距离。三目摄像机能较好地弥补感知范围的问题。因此在业界被广泛应用。

那么测距精度的问题怎么办?

正是由于三目摄像机每个相机的视野不同,因此近处的测距交给宽视野摄像头,中距离的测距交给主视野摄像头,更远的测距交给窄视野摄像头。这样一来每个摄像机都能发挥其最大优势。

三目的缺点是需要同时标定三个摄像机,因而工作量更大一些。其次软件部分需要关联三个摄像机的数据,对算法要求也很高。